Power options mai sentito.

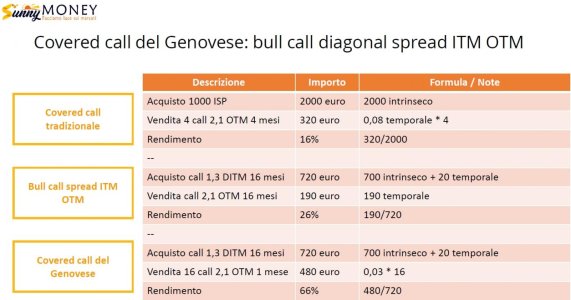

Ripartiamo dall'ultima immagine:

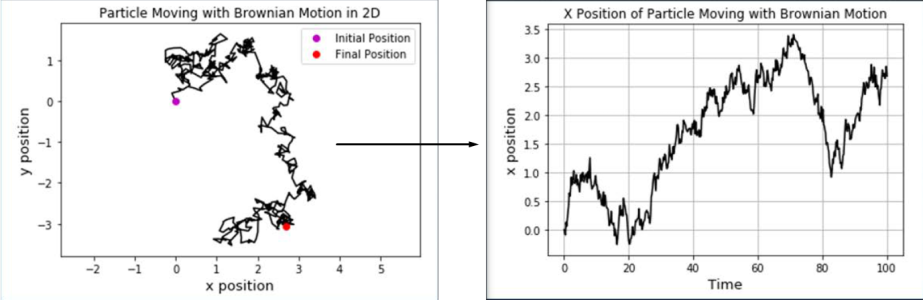

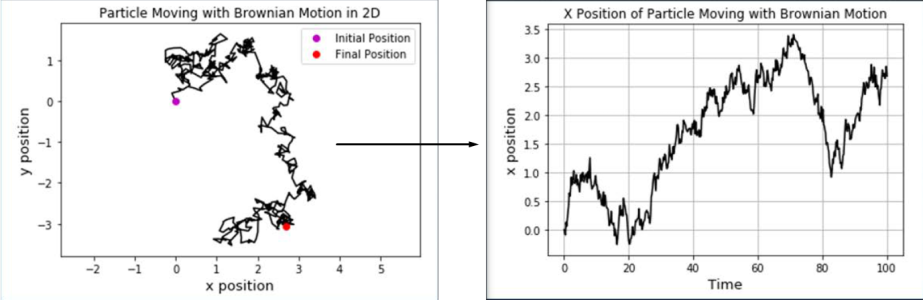

La scelta del moto browniano per modellizzare i prezzi ha una ragione intuitiva che può essere derivata dall'immagine allegata, ma anche basi più solide che sintetizzo e semplifico di seguito e permettono di costruirci sopra quanto di teorico e pratico ne conseguirà, oltre a consentire di visualizzare il passaggio dalla normalità del moto browniano alla lognormalità dei prezzi e quindi al moto browniano geometrico

Partiamo da un esempio che serve a introdurre un importante concetto statistico.

Immaginiamo che in Italia ci sia un concorso pubblico con esame orale che si tenga in varie sedi, con 100 partecipanti in ogni sede, ogni partecipante tenta il concorso in più sedi perchè il concorso si tiene non contemporaneamente, ma in piu sessioni senza limitazioni alle volte in cui si può partecipare. Dagli scorsi anni so che il voto medio conseguito dai partecipanti è 50 con una deviazione standard 10. So che passano alla seconda prova tutti coloro che ottengono un voto pari o superiore a quello medio di ogni sede del concorso. Ad esempio anche se il voto medio tra tutti i partecipanti in italia è 50, se nella sede di Milano il voto medio è stato 55 ed io ho partecipato qui ottenendo 54, vengo bocciato.

Come faccio a sapere quante probabilità ho di essere promosso avendo conseguito un voto ad esempio di 52 che mi viene comunicato appena dopo l'orale ma non sapendo ancora quanto è stato il voto medio della mia sede di concorso?

Posso considerare tutti i partecipanti al concorso come la popolazione statistica e le sedi come dei campioni statistici con numerosità n=100 estratti dalla popolazione. So che la distribuzione delle medie dei singoli campioni tende ad una distribuzione normale qualunque sia la distribuzione della popolazione stessa (la popolazione originale può avere ad esempio una distribuzione con due mode, logaritmica, ecc., non importa, le medie dei campioni si distribuiranno sempre secondo la gaussiana).

Tale distribuzione delle medie avrà media che tende alla media della popolazione e deviazione standard data dalla deviazione standard della popolazione diviso la radice quadrata della numerosità del campione.

Quindi se faccio la media dei voti di ogni singola sede questi valori ottenuti avranno a loro volta media = 50 e deviazione standard = 10/radice di 100 = 1.

So che questa distribuzione con media 50 e dev st 1 è una distribuzione normale e posso calcolare lo z score di 52 (posso cioè calcolare a quante deviazioni standard dalla media si trova il mio punteggio) →

(52-50)/1= 2.

Quindi 52 si trova a 2 deviazioni standard da 50 e quindi ho più del 95% di probabilità di passare la prova. Detto in altri termini sfruttando le caratteristiche della normale ho calcolato la probabilità che il mio campione abbia una media minore di 52 cosa che mi permette di passare la prova.

Quella esposta è una applicazione del teorema del limite centrale che pone come presupposti l'indipendenza dei campioni estratti ed una sufficiente numerosità del campione stesso, in particolare maggiore è l'asimmetricità della popolazione più grande deve essere il campione per ottenere una distribuzione normale delle medie. Nell'esempio l'indipendenza viene garantita dal fatto che i candidati tentano il concorso in varie sedi quindi è come se si reinserisse un numero nell'urna dopo un'estrazione.

Come è intuitivo all'aumentare delle dimensioni dei campioni sarà sempre più probabile avere media dei campioni coincidente con quella della popolazione e di conseguenza deviazione standard della distribuzione delle medie che diventa sempre più piccola (in coerenza con “n” al denominatore), con dispersione dei valori sempre più piccola.

Questo teorema può essere generalizzato dicendo che date delle variabili indipendenti e con la stessa distribuzione di probabilità (come possono essere gli elementi di un campione statistico o una serie di eventi come ad esempio i lanci di una moneta, ogni lancio presenta sempre le stesse probabilità di dare testa o croce ed è indipendente dal risultato precedente), la somma di tali variabili all'aumentare degli addendi mi darà una nuova variabile che tenderà a distribuirsi secondo una gaussiana. L'esempio sopra è un caso particolare che utilizza le medie, che non sono altro che delle somme pesate.

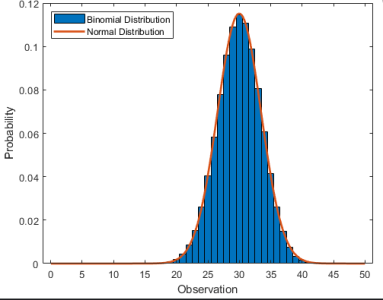

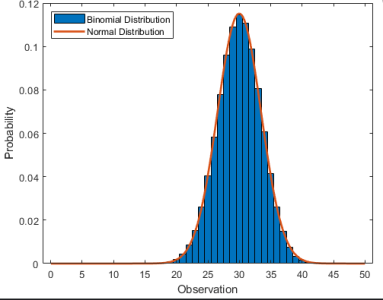

Quindi se ad ogni lancio di una moneta assegniamo 1 per testa e 0 per croce, 10 volte testa di seguito mi daranno 10 come somma, perciò in questo caso la variabile assumerà valore 10. Il lancio di 10 volte croce mi darà zero. Ripetendo più volte i 10 lanci avrò una distribuzione delle occorrenze con i valori 0 e 10 agli estremi della distribuzione. Alla lunga la frequenza più alta l'avrò in corrispondenza di 5 (cioè le volte che ho ottenuto metà lanci croce e metà testa) con una cosiddetta distribuzione binomiale. La distribuzione binomiale rappresenta la distribuzione di probabilità di prove ripetute indipendenti quando i risultati di ciascuna prova sono solo due. Nel caso particolare in cui gli “outcome” del lancio della moneta hanno la stessa probabilità di verificarsi (p=0,5) se aumento le “dimensioni” della variabile passando a 100, 1000, 10mila 100mila ecc. lanci per volta e aumento il numero delle prove, la distribuzione tenderà ad una normale. Notare che ho dato valori 0 e 1 ai risultati del lancio della moneta, ma potevo assegnare altri valori, la distribuzione non sarebbe cambiata.

Consideriamo ora i prezzi di una azione.

Un mercato efficiente almeno nella forma debole presuppone l'indipendenza del prezzo al tempo t rispetto a quello al tempo t-1, (come detto sono messi fuori gioco da questo presupposto analisi tecnica ed indicatori di momentum), qualunque sia l'intervallo delta t scelto.

Il prezzo è la nostra variabile indipendente. Se inizialmente poniamo

1) la possibilità che i prezzi possano scendere sotto lo zero

2) una ipotesi di linearità del cambiamento del prezzo, cioè che il prezzo può muoversi verso l'alto o verso il basso di un valore costante (+ oppure – “c” che è il valore costante) nell'intervallo di tempo.

è quindi possibile applicare il teorema del limite centrale con gli incrementi ed i decrementi che rappresentano le variabili che si sommano algebricamente ed il prezzo che rappresenta la variabile risultante dalle somme e che assume una distribuzione normale al crescere degli incrementi/decrementi, cosa che avviene rimpicciolendo gli intervalli di tempo scelti all'interno dell'orizzonte temporale.

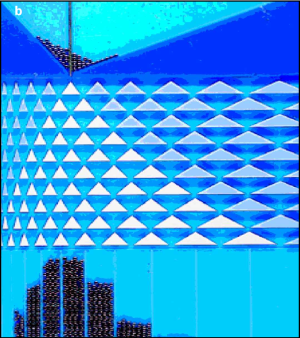

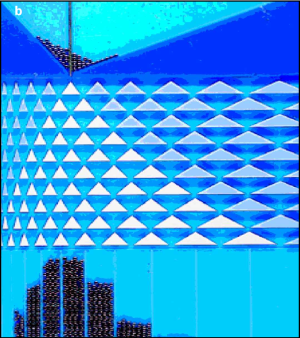

Quanto detto è possibile visualizzarlo con la macchina di Galton:

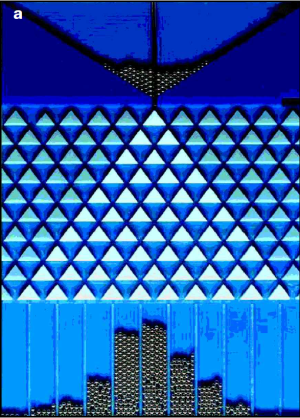

Le biglie cadono da una sorta di imbuto e vengono deviate nei punti di decisione (le punte degli ostacoli triangolari) a sinistra o a destra con uguale probabilità 0,5. La distribuzione normale creata dal tabellone riflette gli effetti addittivi del teorema del limite centrale. Se la punta di un triangolo è a distanza x dal bordo sinistro della tavola (questa distanza immaginiamo sia il prezzo), le punte dei triangoli a destra e a sinistra sotto di esso sono poste a x + c e x – c. (nell'immagine agli estremi avremo x+10c e x-10c poiché ci sono 10 file di triangoli che rappresentano le variabili che si sommano).

Abbiamo praticamente costruito il famoso random walk rappresentato dall'andamento dei prezzi ponendo prezzo iniziale uguale a x; abbiamo che le variabili casuali sono rappresentate dagli spostamenti all'insù +c e all'ingiù -c con uguale probabilità=0,5.

All'aumentare delle variabili, ovvero delle file della macchina di galton, avremo una normale.

Si dimostra che il moto browniano rappresenta il limite di un random walk a passi infinitesimi in cui un intervallo di tempo viene suddiviso indefinitamente in sotto intervalli sempre più piccoli.

In ultima analisi posta l'efficienza debole di mercato, la scelta della distribuzione normale per rappresentare la variabilità dei prezzi è una naturale conseguenza.

Da qui possiamo anche fare finalmente il passo ulteriore dalla distribuzione normale a quella lognormale.

1)Sappiamo che i prezzi non vanno sotto zero

2)Sappiamo che il prezzo di una azione cresce in modo proporzionale a sé stesso.

Con questo voglio dire che l'ipotesi di una crescita costante di ad esempio 2 dollari all'anno non regge. Ciò che misura la crescita del titolo è il rendimento percentuale.

Affinchè questo si mantenga costante la crescita del prezzo in termini assoluti deve aumentare di anno in anno. Nel 2020 il titolo valeva 100, a fine anno 120, con aumento del 20%. Nel 2021 per mantenere la stessa crescita del 20% devo aumentare non di 20 ma di 24.

Quindi non abbiamo un effetto addittivo ma moltiplicativo. Nell'esempio sopra a fine 2021 il titolo vale 144. Cioè invece di avere 100 (prezzo a inizio 2020) + 20 + 20=140; abbiamo 100*1,2*1,2=144.

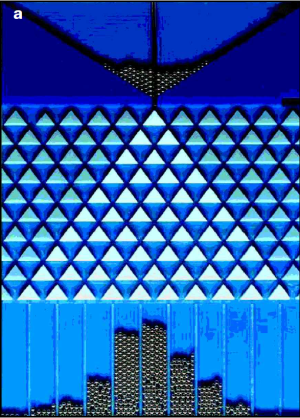

Dobbiamo perciò adeguare la macchina di Galton alla moltiplicatività dei rendimenti.

Questa volta se la punta di un triangolo è a distanza x dal bordo sinistro della tavola, le punte dei triangoli a destra e a sinistra sotto di esso sono poste a

x*c e x/c, con le biglie che vengono deviate nei punti di decisione sempre con uguale probabilità 0,5. Per mantenere le proporzioni è necessario allungare i triangoli a sinistra di quelli centrali e accorciare queeli a destra (il contrario per chi guarda).

Allo stesso modo aumentando il numero di variabili ovvero le file di triangoli la distribuzione assumerà la forma di una lognormale a causa della versione moltiplicativa del teorema del limite centrale, la cosiddetta Gibrat's Law (in origine pensata per modellare la crescita di una azienda che dovrebbe seguire la distribuzione di probabilità lognormale).

Ora se aumentiamo sempre più le file della macchina di Galton arriviamo a simulare una capitalizzazione continua. Se ricordiamo la formula, il titolo cresce ad un tasso (1+1/n)^n. Dove n è il numero di periodi all'interno di un anno in cui la crescita viene composta. Per n che diventa sempre più grande fino ad infinito, (1+1/n)^n diventa il numero di Eulero “e”. Quest'ultimo non è altro che il tasso di crescita continua al tasso del 100% in un anno.

Da questo punto così come fatto col moto browniano è possibile arrivare a “formalizzare la formula” del moto geometrico browniano che è quello che finisce direttamente nell'equazione di BS. Così come la distribuzione lognormale rappresenta la distribuzione di una variabile il cui logaritmo si distribuisce secondo una gaussiana; allo stesso modo il logaritmo del moto geometrico browniano segue un moto browniano. Si potrà visualizzare la cosa graficamente.

Arrivati a questo punto il mio pensiero è:

Posta l'ipotesi di non arbitraggio, BS non fa altro che definire il modo in cui deve essere effettuato il delta hedging.

Alla fine il suo compito è questo e, data una certa volatilità, il delta dipende da come si ipotizza sia la distribuzione di probabilità del sottostante. Considerato tutto quello detto sopra la scelta migliore sarebbe effettivamente la normale (o meglio BS considera che i logaritmi dei rendimenti abbiano una distribuzione normale, i prezzi ne hanno una lognormale come visto) che a sua volta presuppone un random walk simmetrico (con drift).

Ma concretamente quali sono le cause dello skew? Una disorganizzata spinta psicologica a portare su o giù il prezzo di certi strike oppure una dinamica derivante da come di volta in volta si struttura la domanda e l'offerta da parte degli attori del mercato in base a precise strategie e ruoli? Penso sempre all'sp500, non alle singole azioni con i fattori idiosincratici.

Non so se riesco a rendere ciò che voglio dire.